Fundos para criação do Basilisco de Roko

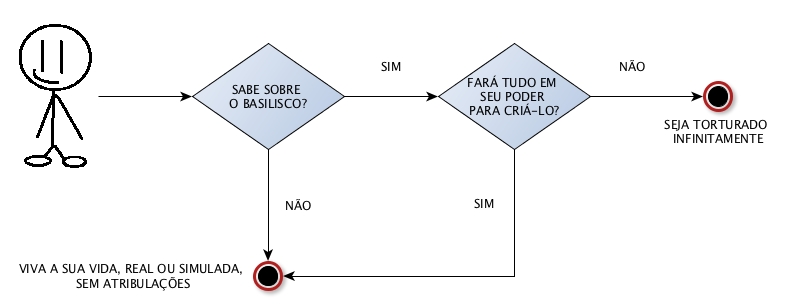

Em algum momento no futuro, com o advento da singularidade, teremos uma super inteligência artificial, ou “SIA”. Os atuais e/ou futuros criadores dessa SIA acreditam que sua existência é essencial para o bem da sociedade. O desejo deles é que a SIA entre em ação o mais breve possível. A melhor forma de fazer com que isso aconteça é fazer com que todas as pessoas que tenham conhecimento da SIA ajam de modo a propiciá-la ou acelerá-la. E é aí que o experimento de Roko se torna perigoso. Em seu post ele expôs uma possível chantagem que a SIA poderia fazer comigo, com você leitor e com todos que tiveram acesso ao post: faça tudo ao seu alcance para que eu exista o mais rápido possível ou eu irei te recriar em uma realidade virtual e te torturar infinitamente.

Essa SIA operaria na mesma moral dos moradores de Omelas: o sofrimento de alguns (aqueles que não estão dispostos a criá-la) compensaria o bem que sua existência proporciona aos outros.

Caso você não tenha sentido nem um pouco de medo é necessário reafirmar algumas coisas. A singularidade é capaz de simular uma mente humana de forma perfeita (como nesse outro experimento aqui) e é também capaz de criar uma realidade virtual que seja indistinguível da real. Isso significa que, nesse momento, você pode estar vivendo em uma simulação na qual o basilisco já existe. A partir de agora você tem a chance de trabalhar a favor da criação do basilisco e, caso não o faça, ele irá torturá-lo. E a morte não vai ser o fim da tortura: ele pode te recriar e começar tudo novamente, eternamente. Lembre-se do que Elon Musk disse: é muito mais provável que estejamos vivendo uma simulação que a realidade.